データと統計学

これまでに統計学を学ぼうと志した人の多くは複雑な公式や計算を目の当たりにして何度も挫折してしまったのではないでしょうか?しかし、難解に見える数式を理解する前に、まず、統計学とは意思決定を手伝うツールであることを理解しましょう。

統計学は、集めたデータを見て

- 「このデータは何を表しているのだろうか?」

- 「このデータにはどのような傾向があるのだろうか?」

- 「どのような予測が可能なのか?」

- 「どのような結論が出せるのだろうか?」

と考える手助けをしてくれるツールです。つまり、統計学とは数字の集合体ーデータセットーをモデル化して、その特徴や傾向を理解したり、予測したりするツールです。

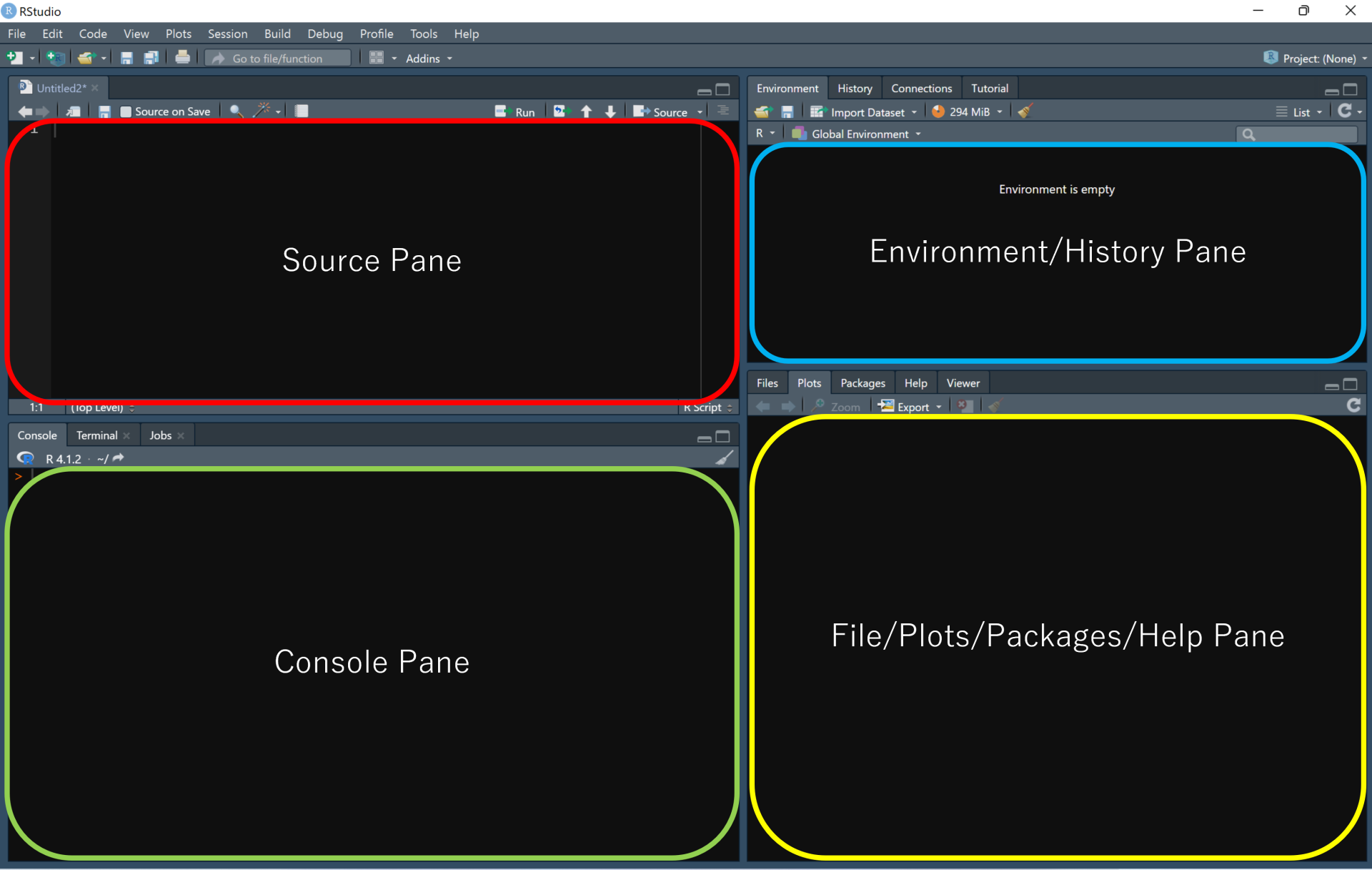

一昔前は膨大なデータを理解するために紙・鉛筆・電卓を使用していたが、近年ではPCの発達に伴いRのようなソフトウェアが開発され、データ分析を格段にシンプルなものにしてくれています。(※Rについて馴染みのない方に、Rとは統計解析のために開発された、分析ツールの多くを実装したコンピュータ言語です。)

では、統計学の基本について一つ一つ分かりやすく解説していきます。

母集団と標本

統計学初心者の方でも母集団や標本という言葉を耳にしたことがあると思います。

- 母集団:対象となる全ての集合体

- 標本:母集団から抽出された部分的な集合体

最も一般的な例として選挙が考えられます。選挙の母集団とは、その選挙の投票権を有するすべての有権者ですね。一方で、標本とは、テレビ放送などで耳にする出口調査と考えて頂いて問題ありません。そして、適切な出口調査により標本が母集団を代表していれば、標本データを使って集団についての結論を導き出すことができます。つまり、当選確実な候補者を母集団の一部である標本より予測することが可能というわけです。こう考えると、統計学とは、標本から得られたデータを使って、母集団についての結論を導き出すツールであるといえます。

一般に母集団の特性(母集団の平均値など)はパラメータと呼ばれ、標本の特性(標本の平均値など)は統計量と呼ばれます。標本の特性(標本から得られた身長・体重など)だけに関心がある場合、計算する統計は記述的なものです。母集団の特性を推定することに関心がある場合、統計量は推論的なものになります。

統計学的表記法

統計学の数式表記法には慣例があります。

例えば、統計学では、ギリシャ文字(μ、σ、ρ)でパラメータを表し、英文字(x、s、r)で統計量を表します。

独立変数(目的変数)と従属変数(説明変数)

変数とは、複数の値を取り得るものを指します。反対に1つの値しか持たないものは定数といいます。

統計学で扱う2つの変数は、独立変数(目的変数)と従属変数(説明変数)です。どんな調査や研究においても、この2つの変数があります。独立変数とは、研究者が測定する変数です。そして、従属変数とは、研究者が操作する変数です。言い換えると、研究者は独立変数を操作することができません。その代わり、研究者は独立変数の変化が従属変数の変化と関連しているかを調べることで結論を導き出します。

簡単に独立変数と従属変数の違いを出来る限りシンプルにこの2つの違いを説明るなら、

- 独立変数=原因=f(x)

- 従属変数=結果=y

です。

従属変数とはとは、原因と結果が成り立つ関係において原因となる変数を指します。つまり、結果(y)を予測するための、f(x)のxのことです。言い換えれば、結果を説明するための変数と捉えれば覚えやすいかもしれません。説明変数は、”独立変数”とも呼ばれています。

この場合は、”他の原因(変数)とは独立した(=互いに影響を及ぼさない)変数”であると捉えて下さい。

説明変数は1つとは限りません。

どちらかというと複数の説明変数により予測されることが一般的です。

例えば、年収予測のための説明変数として考えられるのは

- 年齢

- 職業

- 教育年数

- 性別

などが挙げられます。

しかし、説明変数が多ければ多いほど良いというのも間違いです。

研究者は適切な変数を選んで分析する知識も必要であることを覚えておいてください。

目的変数とは

一方、目的変数とは上記の説明変数によって説明される変数のことです。

原因と結果でいえば、結果(=y)のほうです。

説明変数によって求める目的の変数と覚えるといいですね。

目的変数は従属変数ともいわれます。

上記の独立変数の対義語で、独立変数の変化に依存(従属)する変数という意味です。

説明変数は複数可能ですが、目的変数は1つです。

例えば、中古車を購入する場合、

- 年式

- 走行距離

- 色

- オプション装備

などから、目的変数である購入価格を予想することができます。

データの尺度

独立変数や従属変数には、名義、順序、間隔、比率のいずれかの尺度があります。

名義データ

- 数値の集合が名義データであった場合、数値は単にラベルであり、その値は何も意味しません。例えば、野球選手背番号は名義尺度データです。背番号は名義目的なものであり、選手を識別するだけで、数字の大小に意味は無いですよね。

順序データ

- 順序と名前が付くように数値の順序が重要となります。

- 例えば、10種類の食品を、一番好きなもの(1)から一番嫌いなもの(10)までランク付けしてもらうと、1~10には順序が含まれているデータとなります。

- しかし、3番目に好きな食べ物と4番目に好きな食べ物の差は、9番目に好きな食べ物と10番目に好きな食べ物の差と同じとは限りません。つまり、順序データには、等間隔や間隔差という概念が欠けているのです。

間隔データ

- データの間に等しい差が得られます。温度(摂氏・華氏)が良い例です。30℃と40℃の差は、90℃と100℃の差と同じ、等間隔です。

- しかし、80℃は40℃の2倍ではありません。なぜなら「2倍」とか「半分」が意味を持つためには、「0(ゼロ)」は測定対象が完全に存在しないことを意味しなければならないのです。つまり、「0℃=熱が全く無い」ことを意味する絶対温度(ケルビン)でなければ、比率を意味しないのです。

比率データ

- 全くないという意味のゼロ点が存在する。

- 上述の温度の例でいえば、絶対温度(ケルビン)では、ゼロは「絶対零度」を意味し、そこではすべての分子運動(熱)が停止した状態です。そして、200℃は100℃の2倍の温度ということになります。

- 他にも比率データの例として、「長さ」もあります。8㎝は4㎝の2倍ですね。そして、0㎝は 「長さが全くない 」という意味です。

統計学と確率論

統計的な有意性とは、その事象についての「どのくらい起こりやすいか」という確率が重要となります。統計学は絶対的な情報ではなく、どの程度の確率で起こるかという情報が得られるのみであることを常に頭に置いておきましょう。

では、その確率とは何でしょうか?

最も代表的な確率の例として、コインを投げたときの表が出る確率、サイコロの1の出る確率の例が挙げられます。

確率を一般化するならば、ある事象が起こる確率を知りたければ、その事象が何通り起こり得るかを数え、起こり得る事象の総数で割れば求めることができます。

コイン投げならば、表(1)を表裏(2)で割る(1/2)。サイコロ投げの場合は、1を6で割る(1/6)ことですね。

もう少し複雑な例を考えてみましょう。例えば、上記の「コインを投げ」と「サイコロ振り」を同時に行った場合ではどうでしょうか?コインとサイコロを手にもって同時に投げた時、コインの表と1の目がでる確率は?

この場合の起こりうる事象の総数は、コイン投げの2とサイコロ振りの6を掛けた12となります。そして、起こった事象(表と1の目)は1ですから、確率は1/12となります。

一般に、ある事象が発生する確率を表す式として

確率 =事象が発生しうる数 ÷ 事象の総数

となります。

まとめ

統計学の基本てきな考え方を簡単にまとめてみました。

母集団・標本、表記方法、変数、尺度、確率論など、統計学を学習するうえで欠かせない基本概念ですので、しっかり押さえておきましょう!

コメント